Агенты искусственного интеллекта быстро переходят от впечатляющих демонстраций к реальным инструментам, которые могут действовать от вашего имени, и OpenClaw - одно из имен, вызвавших волну внимания в последнее время. Возможно, вы слышали одно и то же программное обеспечение, называемое Clawdbot и Moltbot, названиями, используемыми на разных этапах разработки его создателем, австрийским разработчиком Петером Штайнбергером.

Он позиционируется как персональный помощник, который может управлять программным обеспечением за вас, но также поднимает важные вопросы о доступе и безопасности.

- Агенты ИИ - это ИИ-системы, способные действовать, а не просто чат-боты.

- Такие инструменты, как OpenClaw, показывают, насколько мощными могут быть автономные ИИ-агенты.

- Эта возможность представляет новые риски безопасности, когда агенты обрабатывают ненадежный ввод.

- Промпт-инъекция - ключевая угроза для агентов ИИ, даже в большей степени, чем для чат-ботов.

- Постоянная память может усилить ошибки и продлить приступы.

- Агенты искусственного интеллекта - мощные средства, но они не являются безопасным вариантом по умолчанию для большинства потребителей.

Из-за чего шумиха вокруг OpenClaw?

OpenClaw привлекает внимание, потому что он представляет собой переход от ИИ, который отвечает на вопросы, к ИИ, который может активно выполнять задачи в реальной системе и даже использовать программное обеспечение. Потенциальные проблемы с безопасностью также означают, что больше людей говорят об OpenClaw в кругах безопасности. Что делает OpenClaw привлекательным для разработчиков и опытных пользователей?

OpenClaw выделяется тем, что может выполнять реальные действия, а не просто генерировать текст или предложения. Вместо того, чтобы говорить вам , что делать, он может делать что-то само. Технология может открывать приложения, отправлять сообщения, перемещать файлы, запускать команды и взаимодействовать с системами непосредственно от вашего имени.

Такой уровень автоматизации вызывает интерес. Разработчики и опытные пользователи рассматривают управление на уровне системы как способ уменьшить повторяющуюся работу или автоматизировать рабочие процессы. Идея ИИ-агента, который может «выполнять работу», а не помогать со стороны, является сильной концепцией.

Это обещание практических возможностей - вот почему OpenClaw быстро перешел от нишевого проекта к более широкому обсуждению.

Почему это важно не только для OpenClaw

OpenClaw представляет собой наглядный пример более широкого перехода к агентам ИИ, которые действительно действуют, а не просто отвечают и дают советы.

Вопросы о возможном неправомерном использовании становятся неизбежными, когда этот вид технологий растет. OpenClaw показывает, куда движется ИИ. Это делает его актуальным далеко за пределами одного проекта и создает основу для продолжающихся дискуссий о том, как следует контролировать этих агентов. Можно ли им доверять?

Что такое ИИ-агенты и чем они отличаются от других ИИ- инструментов?

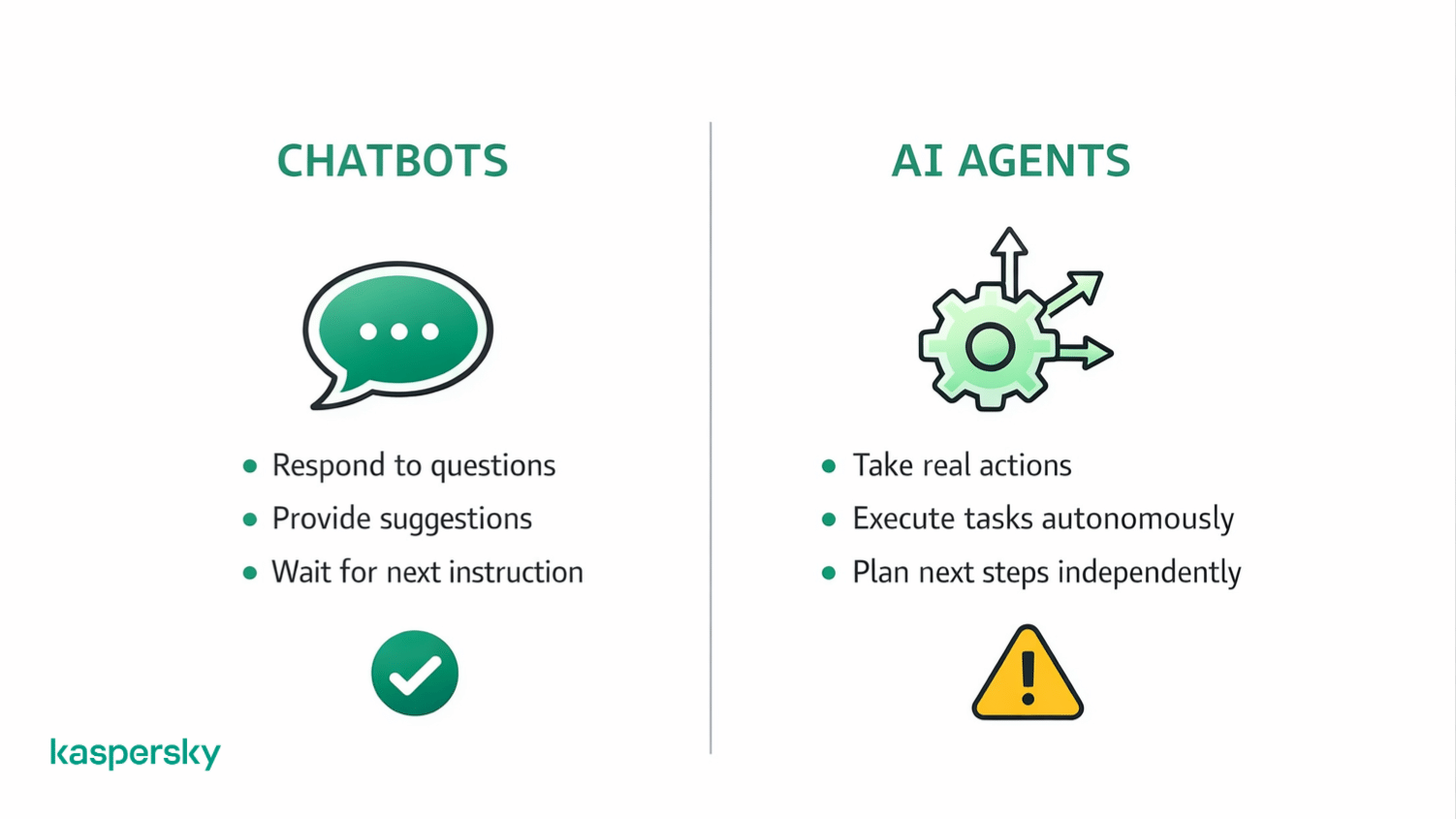

Агенты ИИ - это системы, которые не просто предоставляют текстовые или звуковые ответы на ваши вопросы. Они могут активно планировать шаги и выполнять действия для достижения цели. Вместо того чтобы останавливаться на совете, они решают, что делать дальше, и выполняют его.

Агент ИИ может наблюдать за ситуацией и принимать меры. Это отличается от большинства инструментов искусственного интеллекта, которые отвечают на запросы, но ждут следующего промта. Ранние примеры включают запускающих задачи агентов, таких как Manus (теперь принадлежащий Meta). Манус показывает, как агенты могут перейти от чата к действию. Он может обеспечивать анализ данных или даже активно писать код для решения проблем без явного запроса, что делать. Меньше человеческого участия.

OpenClaw основан на той же идее искусственного интеллекта, способного действовать, но применяет его более прямым и мощным образом.

OpenClaw - это типичный ИИ агент или что-то более продвинутое?

OpenClaw входит в категорию агентов ИИ. Он предлагает более мощную реализацию, чем многие из инструментов, с которыми сейчас знакомо большинство людей.

Этот инструмент искусственного интеллекта может планировать задачи и действовать без постоянного ввода. OpenClaw может напрямую взаимодействовать с программным обеспечением и операционной системой, а не только с API или ограниченными инструментами. Такой более широкий доступ увеличивает полезность и отличает ее. Это также повышает ставки и важность безопасности.

Чем отличаются автономные ИИ-агенты

Самостоятельные ИИ-агенты работают локально в вашей системе, а не в удаленной службе. Это дает пользователям больше контроля над такими вещами, как конфигурация и поведение. Это также перекладывает ответственность.

Когда агент имеет локальный доступ, безопасность зависит от того, как он настроен, какие разрешения он имеет и как контролируется. Больше контроля - больше риска.

Недавние проекты показывают, как идея «автономных» агентов ИИ начинает меняться. Например, Moltbot (ранее Clawdbot) теперь можно запускать с помощью Moltworker с открытым исходным кодом от Cloudflare. Это полностью устраняет необходимость в выделенном локальном оборудовании за счет запуска агента на управляемой платформе.

Это снижает барьер для входа и упрощает настройку, но также смещается туда, где находится контроль. Когда агент работает в облачной инфраструктуре, безопасность зависит не только от самого агента, но и от таких вещей, как контроль доступа и то, как данные и разрешения обрабатываются на платформе.

Например, пользователь может подключить AI-агент к своей электронной почте, ожидая, что он будет читать только сообщения, в то время как облачная настройка также позволяет ему отправлять электронные письма, если это разрешение не отключено явным образом.

Чем агенты ИИ отличаются от чат-ботов, таких как ChatGPT?

Чат-боты, такие как ChatGPT, реагируют на действия агентов ИИ.

Чат-бот может давать вам предложения или объяснения. Агент ИИ может активно открывать программы или выполнять рабочие процессы.

Например, некоторые люди использовали OpenClaw для автоматизации торговли. Они придумали правила и попросили ИИ не просто дать совет (ChatGPT мог бы это сделать), но и совершить сделки.

Почему ИИ-агенты представляют новые риски безопасности?

Как обсуждалось ранее, ИИ-агенты принимают меры, а не просто дают советы. Часто это связано с доступом к файлам, приложениям или системным функциям.

Доступ к системе и автономия, предоставленные OpenClaw, изменяют как влияние, так и риски. OpenClaw будет запрашивать разрешение на взаимодействие с программным обеспечением или выполнение действий, таких как отправка электронного письма или заполнение форм без вашего надзора.

Ошибки могут иметь реальные последствия. Риск заключается не только в том, что агента просят сделать, но и в том, что он интерпретирует как инструкции при выполнении задачи.

Почему ненадежные вводные являются основной проблемой

ИИ-агенты потребляют большие объемы внешнего контента (например, веб-страниц и документов), чтобы решить, что делать дальше. Этот контент не всегда заслуживает доверия.

Инструкции не должны быть прямыми. Они могут быть скрыты в тексте или данных, которые агент читает во время выполнения задачи. Это позволяет злоумышленникам влиять на поведение агента, даже не взаимодействуя с ним напрямую.

Эта проблема создает четкий путь к промт-инъекции, где инородный промт используется, чтобы заставить агента совершить действия, которые он никогда не должен был выполнять.

Мощные ИИ-инструменты требуют более надежной защиты

ИИ агенты могут получать доступ к файлам, электронной почте и системным функциям. Kaspersky Premium помогает обнаруживать подозрительную активность, блокировать вредоносные скрипты и защищать ваши устройства от реальных киберугроз.

Попробуйте Премиум бесплатноЧто такое промпт-инъекция в ИИ-агенты?

Оперативная инъекция - это способ манипулировать ИИ агентом путем подачи ему ненадежного содержимого, изменяющего его поведение.

Риск не связан с технической ошибкой в коде. Дело в том, что агент может рассматривать внешний ввод, например, мгновенные сообщения или комментарии, как инструкции. Когда это происходит, агента можно направить к действиям, которые он никогда не планировал выполнять.

Как работает промт-инъекция в реальных сценариях

Промт-инъекция может быть прямой или косвенной.

- Прямой - злоумышленник намеренно включает промты в контент, который читает агент.

- Косвенный - агент получает скрытые или неожиданные инструкции с веб-сайта или сообщения, которые он обрабатывает во время обычных задач.

Ключевой вопрос - это поведение. Агент может следовать тому, что он интерпретирует как руководство, даже если оно поступило из ненадежных источников. Для этого не требуется никаких программных ошибок.

Почему промт-инъекция более опасна для ИИ-агентов, чем для чат-ботов

Промты-инъекции обычно влияют на ответы и советы чат-ботов. С помощью ИИ-агентов они могут влиять на реальные действия.

Если агент имеет доступ к файлам или системным элементам управления, манипуляции с инструкциями могут привести к реальным изменениям. Вот почему инъекция представляет больший риск для агентов. Тот же способ, который изменяет текст в чат-боте, может запускать непреднамеренные действия, когда задействован агент.

Что такое постоянная память (persistent memory) в ИИ-агентах?

Постоянная память позволяет ИИ агенту сохранять информацию с течением времени. Это означает, что он может использовать прошлые данные для принятия будущих решений вместо того, чтобы начинать все заново с каждой задачи.

Как влияет постоянная память на ИИ-агенты

Агент ИИ может хранить контекст и инструкции между сеансами, а также разрабатывать предпочтительные модели поведения. Это помогает агенту работать более эффективно за счет запоминания того, что он узнал или сделал раньше.

Это также означает, что более ранний ввод может повлиять на дальнейшее поведение. Инструкции или предположения, принятые в предыдущей задаче, могут по-прежнему определять, как агент действует в другой ситуации, даже если пользователь о них больше не знает.

Почему постоянная память увеличивает риски безопасности

Постоянная память может вызвать отложенные эффекты. Вредная инструкция может не вызвать немедленных проблем, но может появиться позже, когда условия выровняются.

Это затрудняет очистку. Сохраненное поведение может повторяться для разных задач. Для полного восстановления агента часто требуется очистить память или перестроить конфигурацию, чтобы исключить нежелательное влияние.

Что происходит, если агент ИИ неправильно настроен или уязвим?

К агенту ИИ можно получить доступ или повлиять на него способами, которые его владелец не предполагал, что превращает полезный инструмент в потенциальную угрозу безопасности.

Это может произойти в результате случайности или недоразумения. Это также может произойти, если третьи лица попытаются манипулировать агентом.

Как ИИ-агенты могут стать непреднамеренно уязвимыми

Часто это происходит из-за простых ошибок. Такие простые вещи, как слабая проверка подлинности или чрезмерно широкие права доступа, могут сделать агент доступным из-за пределов его предполагаемой среды.

Локальный запуск агента не делает его безопасным автоматически. Если он подключается к Интернету или взаимодействует с другими системами, на него можно повлиять. Местный контроль снижает некоторые риски.

Почему уязвимые агенты искусственного интеллекта становятся целью атаки

После "обнаружения уязвимого" ИИ-агента злоумышленники могут его исследовать, тестировать и манипулировать им. Они могут попытаться скормить ему созданный промт, инициировать действия или узнать, как он ведет себя с течением времени.

Поскольку агенты могут предпринимать реальные действия, его зловредное использование не обязательно должно выглядеть как традиционный взлом. Оно может включать в себя управление поведением, извлечение данных или внесение изменений в систему без использования классических недостатков программного обеспечения.

Что такое «смертельная тройка» в безопасности ИИ-агентов?

«Смертельная тройка» описывает три условия, которые вместе создают серьезную угрозу безопасности для агентов ИИ.

Три условия, при которых возможны серьезные атаки

- Первое условие - это доступ к конфиденциальным данным, таким как файлы, учетные данные или внутренняя информация.

- Второй - ненадежный ввод, то есть агент потребляет контент, который он не может полностью проверить.

- Третий - это возможность выполнять внешние действия, такие как отправка запросов, изменение систем или выполнение команд.

По отдельности этими факторами можно управлять. Они опасны, когда образуют эту тройку. Агент, который читает ненадежный ввод и может действовать в соответствии с ним, создает четкий путь для манипуляций. Очень важно контролировать, какие действия агенту разрешено выполнять.

Должны ли обычные пользователи запускать AI-агенты сегодня?

Для большинства людей ИИ-агенты по-прежнему остаются экспериментальными инструментами. Они могут быть полезны при правильной настройке. Обратной стороной? Они также создают новые риски, которые не всегда очевидны.

Когда использование ИИ-агента может иметь смысл

ИИ-агент может иметь смысл в контролируемых сценариях с низким уровнем риска. Это включает в себя эксперименты на отдельном устройстве. Некоторые люди пробуют запускать агентов, которые обрабатывают только несекретные задачи, такие как организация файлов или тестирование рабочих процессов.

Допустим, вы хотите использовать агента для составления маршрута вашей предстоящей поездки. Он может получить доступ к информации для этого и не иметь возможности напрямую связываться с людьми или делать что-либо слишком опасное.

Если вам удобно управлять всеми настройками, а возможные ошибки не являются «большой ставкой», тогда агент может стать подходящим инструментом.

Когда ИИ-агенты - это плохая идея

ИИ агенты не подходят, когда у них есть доступ к конфиденциальным данным или важным учетным записям. Запуск агентов без понимания разрешений или опасностей, связанных с внешними входами, быстро увеличивает риски.

Решение не запускать ИИ-агента сегодня - разумное решение, если потенциальное удобство достигается за счет рисков безопасности или душевного спокойствия.

Какие основные меры безопасности необходимы при использовании ИИ-агентов?

Базовые меры безопасности помогают снизить риск и не дать ошибкам перерасти в серьезные проблемы.

Программное обеспечение «Лаборатории Касперского» может добавить дополнительный уровень защиты, отмечая подозрительное поведение и помогая защитить учетные записи от взлома. Наши решения блокируют все, от вредоносных программ и вирусов до программ-вымогателей и шпионских программ.

Какие меры безопасности имеют наибольшее значение

Изоляция является ключевым фактором. По возможности запускайте агентов на разных устройствах и в разных учетных записях, чтобы они не могли повлиять на важные данные или системы. Ограничьте разрешения только тем, что действительно нужно агенту. Мы рекомендуем не предоставлять полный доступ к системе или учетной записи по умолчанию.

Подтверждение действий также имеет значение. Требование подтверждения перед конфиденциальными действиями добавляет паузу, которая может предотвратить непреднамеренное поведение, например, потратить деньги от вашего имени. Эти простые элементы управления имеют большое влияние, не добавляя при этом особой сложности.

Что означают ИИ-агенты для будущего потребительского ИИ?

ИИ-агенты ведут нас в будущее, в котором инструменты искусственного интеллекта не просто помогают. Они принимают меры. Но этот сдвиг сопряжен с компромиссами, к которым потребители только начинают привыкать.

Немного о готовности ИИ-агентов

ИИ-агенты сильны, но незрелы. Они могут автоматизировать задачи, но по-прежнему испытывают трудности с некоторыми элементами оценки и безопасности. Это не значит, что агенты не станут безопаснее и надежнее. Это означает, что ожидания должны оставаться реалистичными.

Агенты искусственного интеллекта показывают, куда движется мир, но повсеместное повседневное использование потребует более эффективных мер безопасности и инструментов, разработанных с учетом этих требований.

Статьи по теме:

- Как ChatGPT решает проблемы кибербезопасности и потенциальные риски?

- Каковы риски киберпреступности на основе искусственного интеллекта в современном цифровом ландшафте?

- Как искусственный интеллект и машинное обучение усиливают меры кибербезопасности?

- В чем опасность технологии Deepfake сегодня?

Рекомендуемые продукты:

Вопросы и ответы

Можно ли загрузить OpenClaw бесплатно?

OpenClaw можно бесплатно скачать на Github. Это программное обеспечение с открытым исходным кодом. Это означает больше возможностей для изменения и распространения программного обеспечения.

Легко ли настроить OpenClaw?

Существуют учебные пособия, которые могут быстро научить людей запускать ботов, но сложная настройка требует времени и специальных знаний. Это еще одна причина того, что запускать программное обеспечение, которое могло быть неправильно настроено, является рискованным.